>

>

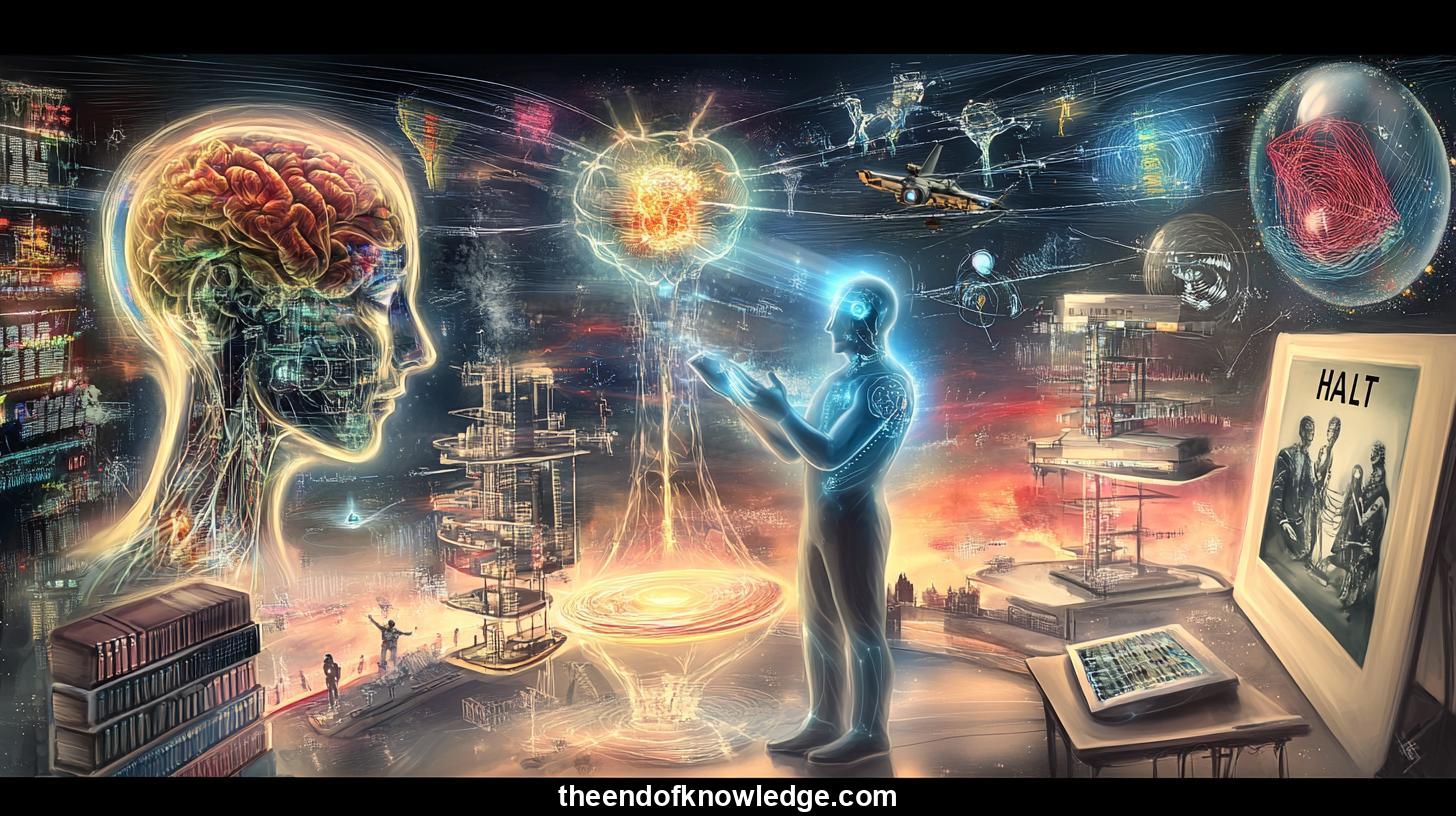

Gráfico de conceptos, resumen y ideas clave utilizando DeepSeek R1 :

Resumen:

La discusión gira en torno a la intersección de la inteligencia artificial (IA), la cognición humana y la naturaleza de la realidad, con un enfoque particular en los fundamentos biológicos y filosóficos de estos temas. Comienza con una exploración de la capacidad del cerebro humano para procesar información, destacando la complejidad de los procesos biológicos como la consolidación de la memoria durante el sueño y el papel de las emociones en la configuración de las experiencias humanas. El ponente destaca las limitaciones de la cognición humana en comparación con la eficiencia de los sistemas de IA, que pueden procesar grandes cantidades de datos sin las restricciones biológicas o emocionales.30 Ideas clave:

1.- El cerebro humano procesa información a través de mecanismos biológicos complejos, incluyendo la consolidación de la memoria durante el sueño.

2.- Los sistemas de inteligencia artificial carecen de restricciones biológicas, permitiendo un procesamiento eficiente de datos sin interferencias emocionales.

3.- Las implicaciones éticas del desarrollo de la IA incluyen el riesgo de mal uso en armas, vigilancia y manipulación.

4.- La responsabilidad en la creación de IA es crucial, ya que tiene el poder de moldear el futuro de la humanidad.

5.- La cognición humana está limitada por factores biológicos y emocionales, a diferencia de la eficiencia computacional de la IA.

6.- El futuro puede involucrar una colaboración humano-IA, donde la IA maneja el procesamiento de datos y los humanos se centran en la creatividad.

7.- La empatía y la creatividad son rasgos únicamente humanos que los sistemas de IA no pueden replicar completamente.

8.- La naturaleza de la realidad se explora a través de discusiones filosóficas y analogías de ciencia ficción.

9.- Los sistemas de IA carecen de conciencia y profundidad emocional, lo que los distingue de las experiencias humanas.

10.- La memoria y la toma de decisiones son áreas potenciales donde la IA podría mejorar las capacidades humanas.

11.- El uso ético de la IA requiere equilibrar la innovación con la responsabilidad social y ambiental.

12.- Las emociones humanas desempeñan un papel crítico en la configuración de las experiencias, a diferencia del procesamiento lógico de la IA.

13.- El potencial de la IA para simular la realidad plantea preguntas sobre la conciencia y la existencia.

14.- Los procesos biológicos como el sueño son esenciales para el aprendizaje y la función cognitiva en humanos.

15.- Los sistemas de IA pueden analizar la actividad cerebral para decodificar pensamientos y visualizar sueños.

16.- La integración de la IA en la vida diaria puede disminuir la dependencia humana de la memoria biológica.

17.- La creatividad y la intuición son capacidades humanas que la IA no puede emular completamente.

18.- El desarrollo de la IA plantea preguntas éticas sobre la privacidad y la seguridad de los datos.

19.- La colaboración humano-IA podría conducir a avances en la resolución de problemas y la innovación.

20.- El futuro de la IA depende de un desarrollo responsable y de directrices éticas.

21.- Los sistemas de IA pueden procesar grandes cantidades de datos, superando las limitaciones cognitivas humanas.

22.- La capacidad del cerebro para crear modelos de la realidad es única en comparación con los métodos computacionales de la IA.

23.- Las experiencias emocionales son centrales para la conciencia humana pero están ausentes en los sistemas de IA.

24.- El potencial de la IA para mejorar la atención médica y la educación es significativo.

25.- Las consideraciones éticas deben guiar la aplicación de la IA en áreas sensibles como la guerra.

26.- La creatividad humana es un rasgo único que los sistemas de IA no pueden replicar completamente.

27.- La intersección de la biología y la tecnología desafía las nociones tradicionales de conciencia.

28.- Los sistemas de IA pueden asistir a los humanos en tareas que requieren precisión y razonamiento lógico.

29.- El uso ético de la IA requiere transparencia y rendición de cuentas en su desarrollo.

30.- La colaboración humano-IA podría redefinir los límites de la creatividad y la resolución de problemas.

Entrevistas realizadas por Plácido Doménech Espí e invitados - Bóveda del Conocimiento construida por David Vivancos 2025