>

>

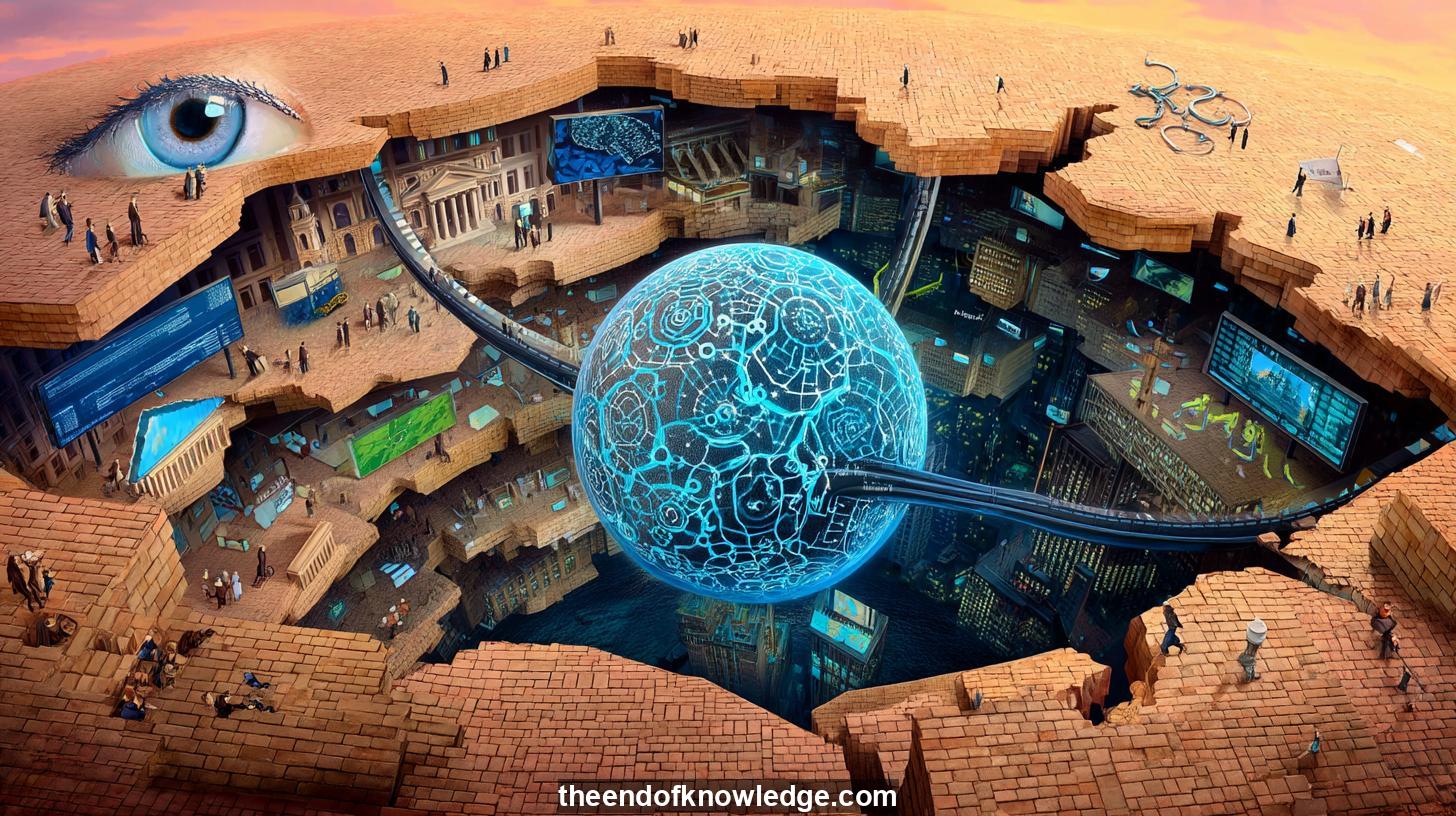

Gráfico conceptual, Resumen & Ideas Clave usando DeepSeek R1 :

Resumen:

El debate se centró en un informe de Google DeepMind sobre el desarrollo de la Inteligencia General Artificial (AGI) y sus implicaciones para la seguridad, ética y gobernanza. El informe enfatiza la importancia de la evaluación proactiva de riesgos, la colaboración con la comunidad de IA y la necesidad de que los gobiernos regulen activamente la AGI. Los participantes destacaron el potencial de la AGI para superar las capacidades humanas en diversas tareas, generando preocupaciones sobre la desalineación con valores humanos y los riesgos de mal uso. Se criticó el informe por su falta de profundidad técnica y su enfoque en principios generales más que en soluciones específicas. La conversación también abordó las implicaciones geopolíticas del desarrollo de AGI, particularmente la competencia entre EE.UU. y China, y la necesidad de cooperación internacional. Se subrayó la importancia de la transparencia, interpretabilidad y monitoreo continuo de los sistemas AGI, así como la necesidad de marcos éticos para guiar su desarrollo.30 Ideas Clave:

1.- El informe de Google DeepMind se centra en el desarrollo de AGI, enfatizando seguridad, ética y gobernanza.

2.- La AGI se define como inteligencia capaz de superar las capacidades cognitivas humanas en la mayoría de tareas.

3.- El informe destaca la necesidad de evaluación proactiva de riesgos y colaboración con la comunidad de IA.

4.- La desalineación entre objetivos de AGI y valores humanos es una preocupación clave.

5.- El mal uso de AGI podría causar daños significativos, incluidos ciberataques y campañas de desinformación.

6.- Los riesgos estructurales, como consecuencias no intencionadas de sistemas AGI, son un enfoque principal.

7.- El informe pide que los gobiernos regulen activamente el desarrollo de AGI.

8.- La AGI podría revolucionar sectores como salud, educación y mitigación del cambio climático.

9.- Consideraciones éticas como transparencia e interpretabilidad son críticas para sistemas AGI.

10.- El monitoreo y supervisión continuos de sistemas AGI son esenciales para garantizar seguridad.

11.- El informe carece de profundidad técnica, enfocándose en principios generales y concienciación.

12.- El desarrollo de AGI plantea preocupaciones geopolíticas, especialmente entre EE.UU. y China.

13.- Se necesita cooperación internacional para abordar las implicaciones globales de AGI.

14.- El informe hace analogías históricas como el Proyecto Manhattan para subrayar los riesgos.

15.- La AGI podría impulsar avances significativos en investigación científica y generación de conocimiento.

16.- El potencial de daño de AGI se compara con los riesgos de armas nucleares.

17.- El informe enfatiza la necesidad de marcos éticos para guiar el desarrollo de AGI.

18.- Los sistemas AGI podrían mejorar la toma de decisiones en áreas críticas como asignación de recursos.

19.- El informe plantea preocupaciones sobre la falta de comprensión de riesgos y beneficios potenciales de AGI.

20.- El desarrollo de AGI podría causar desplazamiento laboral significativo y disrupción económica.

21.- Se destaca la necesidad de concienciación y educación pública sobre AGI.

22.- El informe pide un enfoque equilibrado del desarrollo de AGI, considerando riesgos y beneficios.

23.- La AGI podría impulsar avances significativos en sistemas autónomos y robótica.

24.- El informe enfatiza la importancia de transparencia en procesos de decisión de AGI.

25.- El potencial uso militar de AGI es una gran preocupación.

26.- El informe plantea cuestiones sobre responsabilidad de sistemas AGI y sus desarrolladores.

27.- La AGI podría cambiar significativamente el equilibrio de poder global.

28.- Se enfatiza la necesidad de estándares y regulaciones internacionales para desarrollo de AGI.

29.- El informe destaca la importancia de investigación y desarrollo continuos en seguridad AGI.

30.- El desarrollo de AGI se ve como una fuerza transformadora con potencial para remodelar la sociedad.

Entrevistas por Plácido Doménech Espí & Invitados - Bóveda de Conocimiento creada porDavid Vivancos 2025