>

>

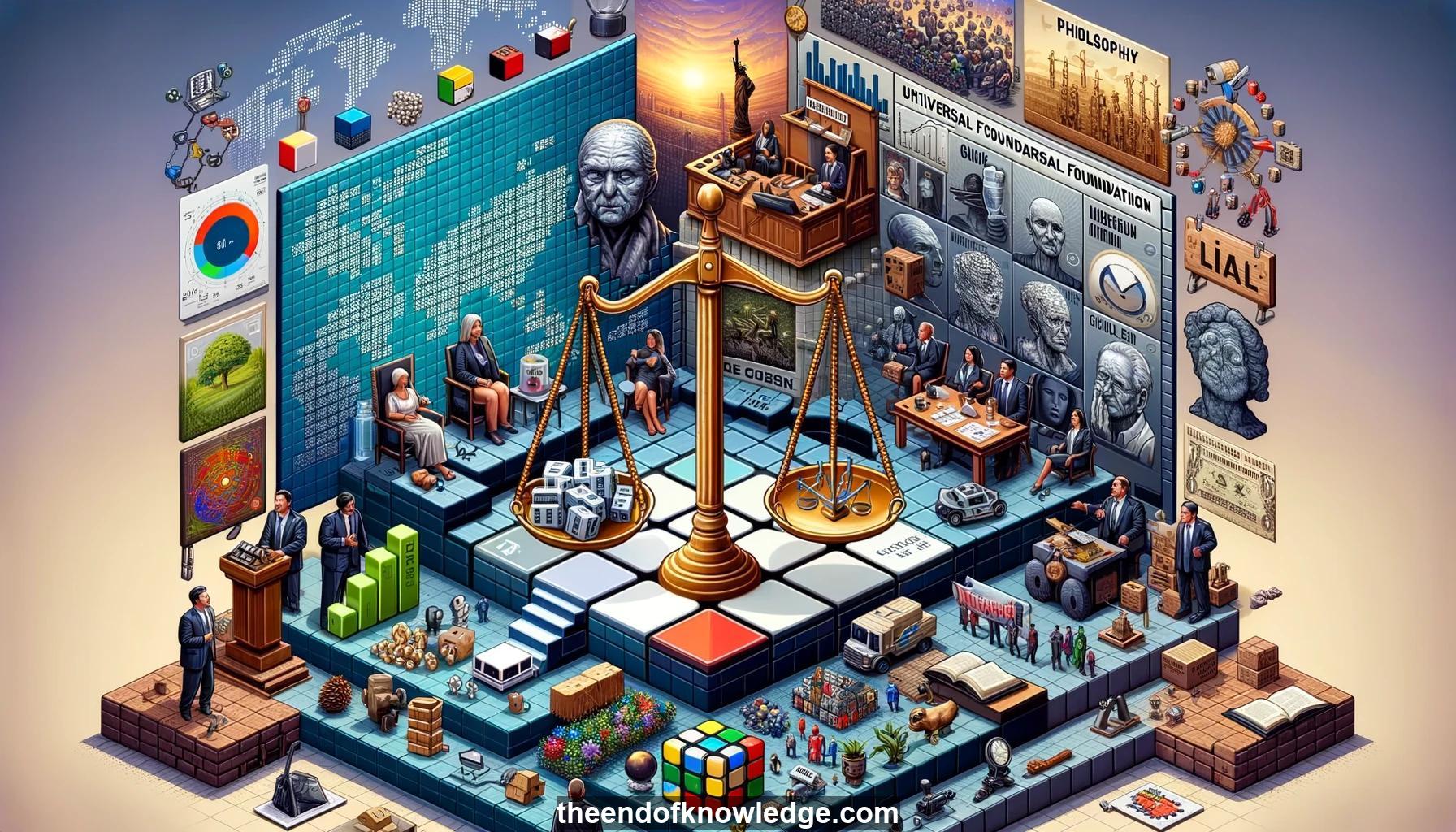

Gráfico de Conceptos & Resumen usando Claude 3.5 Sonnet | Chat GPT4o | Llama 3:

Resumen:

1.- La Máquina Moral: Un proyecto de investigación que explora decisiones éticas para coches autónomos en escenarios de accidentes.

2.- Accidentes inevitables: Los coches autónomos pueden enfrentar situaciones donde el daño es inevitable, requiriendo elecciones éticas programadas.

3.- Conciencia de la industria: Las empresas automovilísticas y tecnológicas reconocen la importancia de abordar problemas éticos en vehículos autónomos.

4.- Limitaciones del marco legal: Las leyes existentes son inadecuadas para programar decisiones éticas en coches autónomos.

5.- Escenarios simples: La investigación inicial se centró en dilemas éticos sencillos, como elegir entre matar a una persona o a muchas.

6.- Complejidad de las elecciones: A medida que los escenarios se vuelven más detallados, las decisiones éticas se vuelven más matizadas y desafiantes.

7.- Participación masiva: El sitio web de la Máquina Moral fue diseñado para recopilar datos de millones de personas en todo el mundo.

8.- Cobertura global: Se recopilaron respuestas de 125 países, proporcionando información sobre variaciones culturales en la toma de decisiones éticas.

9.- Preferencias clave: La gente generalmente prefiere salvar a los humanos sobre los animales, salvar más vidas y salvar a individuos más jóvenes.

10.- Factores controvertidos: El estatus social (por ejemplo, la falta de hogar) tuvo un impacto significativo en las elecciones de las personas en los escenarios.

11.- Clústeres culturales: Los países se agruparon en clústeres occidentales, orientales y meridionales según sus patrones de decisiones éticas.

12.- Legado colonial: Las antiguas colonias a menudo compartían patrones de decisiones éticas con sus países colonizadores.

13.- Correlación de desigualdad económica: Los países con mayor desigualdad económica mostraron sesgos más fuertes contra personajes de bajo estatus.

14.- Correlación del estado de derecho: Los países con instituciones legales más fuertes mostraron sanciones más severas por cruzar imprudente en escenarios.

15.- Correlación de sesgo de género: Los países con mayores brechas de género en salud/supervivencia mostraron sesgo contra salvar mujeres en escenarios.

16.- Fundamentos globales: Algunas preferencias éticas (salvar humanos, muchas vidas, vidas jóvenes) fueron consistentes a través de culturas.

17.- Diferencias culturales: A pesar de algunos fundamentos globales, existen variaciones significativas en las preferencias éticas entre culturas.

18.- No es un ejercicio de votación: La investigación tiene como objetivo informar a los responsables de políticas, no dictar políticas basadas en la opinión popular.

19.- Viabilidad técnica: Aunque algunos factores (como el estatus social) son difíciles de detectar, los factores éticos clave son técnicamente alcanzables.

20.- Decisiones hipotéticas vs. del mundo real: El estudio reconoce la diferencia entre elecciones hipotéticas y el comportamiento del mundo real.

21.- Equilibrio reflexivo: El orador aboga por programar coches basados en una reflexión ética cuidadosa, no solo imitando el comportamiento humano.

22.- Presentación de datos a los usuarios: El estudio exploró cómo mostrar a los usuarios las preferencias de otros podría influir en sus propias elecciones.

23.- Gamificación: El sitio web utilizó elementos de juego para fomentar la participación y el intercambio.

24.- Soporte multilingüe: La Máquina Moral estaba disponible en varios idiomas para maximizar la participación global.

25.- Influencia de YouTube: Los videos creados por usuarios sobre la Máquina Moral ayudaron a aumentar la participación.

26.- Preferencia por la edad: Los individuos más jóvenes (bebés, niños) fueron generalmente priorizados para salvar en escenarios de accidentes.

27.- Preferencia por la especie: Los humanos fueron consistentemente priorizados sobre los animales en escenarios de accidentes.

28.- Preferencia por el número: Los escenarios con más víctimas potenciales fueron generalmente priorizados para salvar.

29.- Efectos de género: Algunas culturas mostraron preferencias por salvar mujeres sobre hombres en escenarios de accidentes.

30.- Implicaciones regulatorias: Los datos podrían ayudar a los reguladores a identificar problemas éticos clave y preocupaciones públicas en sus poblaciones.

Bóveda del Conocimiento construida porDavid Vivancos 2024