>

>

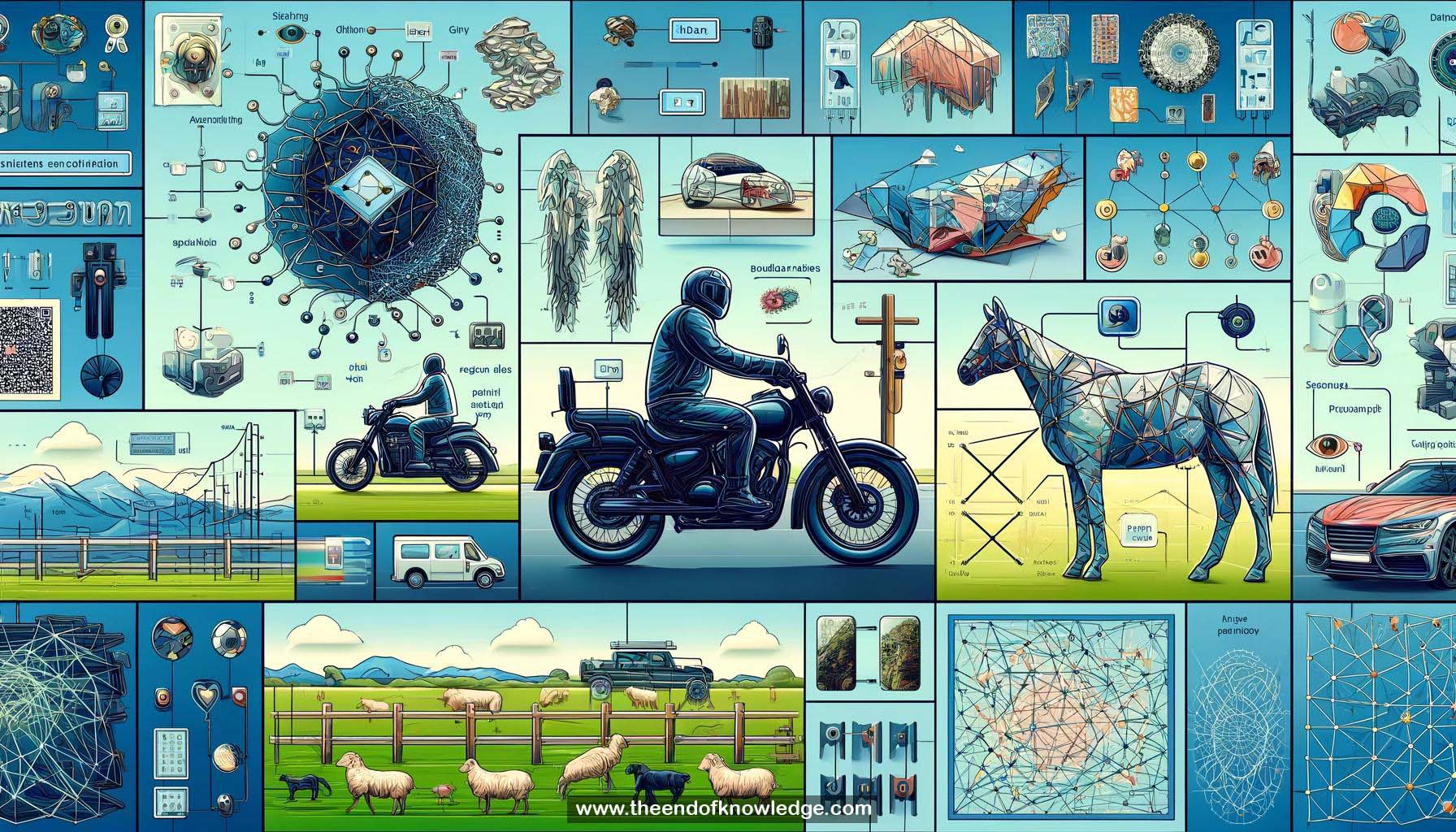

Gráfico de Conceptos & Resumen usando Claude 3 Opus | Chat GPT4o | Llama 3:

Resumen:

1.- Redes Completamente Convolucionales (RCNs): Las RCNs reemplazan las capas completamente conectadas con capas convolucionales, permitiendo predicciones a nivel de píxel para la segmentación de imágenes.

2.- Segmentación Semántica: Tarea de asignar una etiqueta de clase a cada píxel en una imagen, distinguiendo entre diferentes objetos y el fondo.

3.- Estimación de Profundidad Monocular: Predicción de la profundidad de cada píxel a partir de una sola imagen, útil para la comprensión de escenas 3D.

4.- Predicción de Bordes: Identificación de los bordes o límites de los objetos dentro de una imagen para una segmentación más precisa.

5.- Aprendizaje de Extremo a Extremo: Entrenamiento de la red para aprender directamente de las imágenes de entrada a las etiquetas de salida deseadas, optimizando todas las capas simultáneamente.

6.- RCNN: Red Neuronal Convolucional Basada en Regiones utilizada para la detección de objetos, ofreciendo predicciones de cajas delimitadoras pero no etiquetas de píxel precisas.

7.- Submuestreo y Sobremuestreo: Reducción y luego aumento de la resolución de los mapas de características para igualar el tamaño de entrada, crucial para predicciones precisas a nivel de píxel.

8.- Invariancia de Traducción: Las capas convolucionales preservan las relaciones espaciales, permitiendo que la red maneje entradas de tamaños variables.

9.- Capas de Salto: Conexiones que combinan características de diferentes capas de la red para mejorar el detalle y la precisión en los resultados de segmentación.

10.- Chorro Profundo: Combinación de características poco profundas y profundas para capturar tanto información local de alta resolución como semántica de baja resolución.

11.- Capas de Agrupamiento: Submuestrear mapas de características, reduciendo dimensiones espaciales y reteniendo características esenciales.

12.- Pérdida a Nivel de Píxel: Función de pérdida aplicada a cada píxel, guiando la red para mejorar la precisión de segmentación.

13.- Preentrenamiento en ImageNet: Entrenamiento inicial en un gran conjunto de datos (ImageNet) antes de afinar en tareas específicas como la segmentación.

14.- Muestreo de Parches: Método anterior de entrenamiento en parches de imagen, contrastado con el entrenamiento de imagen completa para mayor eficiencia.

15.- CRF Denso: Modelo de Campo Aleatorio Condicional que refina las salidas de segmentación imponiendo consistencia espacial.

16.- Representación Multiescala: Uso de pirámides de imágenes y capas multiescala para integrar información local y global.

17.- Aprendizaje de Salida Estructurada: Marcos de aprendizaje que capturan dependencias entre variables de salida, mejorando la estructura de las predicciones.

18.- Marco Caffe: Marco de aprendizaje profundo utilizado para implementar y entrenar redes convolucionales.

19.- Supervisión Débil: Técnicas de entrenamiento que utilizan etiquetas menos precisas, como cajas delimitadoras o etiquetas a nivel de imagen, en lugar de anotaciones a nivel de píxel.

20.- Conjunto de Datos Pascal: Conjunto de datos popular para la detección y segmentación de objetos, a menudo utilizado para evaluar métodos.

21.- Velocidad de Inferencia: Tiempo tomado para procesar una imagen y producir predicciones de salida, importante para aplicaciones en tiempo real.

22.- GPU Kepler: Unidad de Procesamiento Gráfico utilizada para acelerar cálculos de aprendizaje profundo.

23.- Aprendizaje Multitarea: Entrenamiento de un solo modelo en múltiples tareas relacionadas para mejorar la generalización y la eficiencia.

24.- HiperColumna: Método que combina características de múltiples capas para mejorar el detalle de segmentación.

25.- ZoomOut: Técnica para mejorar las representaciones de características considerando múltiples escalas y contextos.

26.- Detección de Bordes: Identificación de bordes dentro de imágenes para refinar los límites de los objetos en la segmentación.

27.- Límites de Movimiento: Uso de cambios temporales en video para mejorar la segmentación identificando objetos en movimiento.

28.- Media de Intersección sobre Unión (IoU): Métrica para evaluar la precisión de segmentación comparando áreas predichas y de verdad de base.

29.- Etiquetas de Verdad de Base: Anotaciones precisas utilizadas para entrenar y evaluar el rendimiento de modelos de segmentación.

30.- Convolución de Sobremuestreo Denso (DUC): Técnica para aumentar la resolución de los mapas de características para predicciones de segmentación detalladas.

Bóveda del Conocimiento construida por David Vivancos 2024