>

>

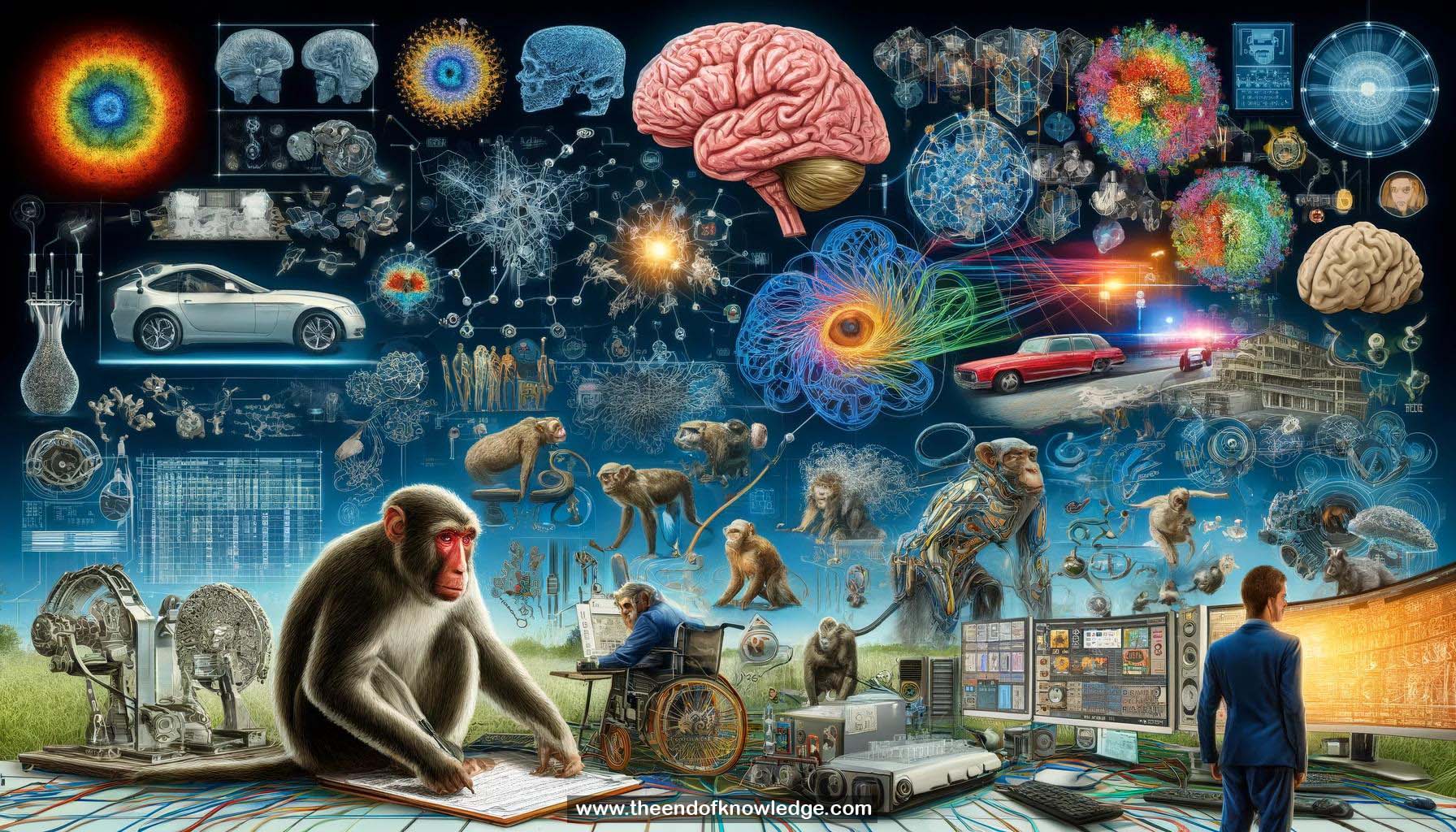

Gráfico de Conceptos & Resumen usando Claude 3 Opus | Chat GPT4o | Llama 3:

Resumen:

1.- Los humanos sobresalen en la percepción de objetos, identificando objetos en escenas a pesar de variaciones en apariencia.

2.- Los neurocientíficos estudian el cerebro para entender los mecanismos neuronales subyacentes a la percepción de objetos.

3.- Enfoque de ingeniería inversa: Construir modelos basados en restricciones cerebrales y compararlos con datos neuronales.

4.- La vía visual ventral, incluyendo áreas V1, V2, V4, e IT, es crítica para el reconocimiento de objetos.

5.- Las neuronas de la corteza IT responden a características complejas de objetos, pero su selectividad no es fácilmente interpretada.

6.- Clasificadores lineales aplicados a datos de población neuronal de IT pueden predecir el rendimiento en reconocimiento de objetos a nivel humano.

7.- Aproximadamente 500 características de IT son suficientes para lograr rendimiento a nivel humano en tareas de reconocimiento de objetos.

8.- Las redes neuronales convolucionales profundas (CNNs) han mostrado un progreso significativo en ajustar datos neuronales de la vía ventral.

9.- Las CNNs optimizadas para tareas tienden a predecir mejor las respuestas neuronales en áreas visuales superiores en comparación con modelos más superficiales.

10.- Las recientes CNNs muy profundas optimizadas para el rendimiento en ImageNet no necesariamente explican mejor los datos neuronales de IT.

11.- Un objetivo es construir modelos de extremo a extremo que predigan con precisión las respuestas neuronales y coincidan con el comportamiento.

12.- Las grabaciones crónicas a gran escala permiten la recolección de datos neuronales extensos de animales despiertos en comportamiento.

13.- Los avances en aprendizaje profundo han llevado a una convergencia entre modelos de visión artificial y biológica.

14.- Comparar patrones de comportamiento de CNN y primates en un gran conjunto de imágenes revela una brecha de rendimiento.

15.- Las imágenes "no resueltas" para las CNNs toman a los primates alrededor de 30ms más para decodificar con precisión que las imágenes "resueltas".

16.- La brecha de rendimiento puede deberse a conexiones recurrentes y de retroalimentación presentes en el cerebro pero no en las CNNs.

17.- Interrumpir la actividad neuronal podría probar el rol causal de la retroalimentación en el procesamiento de imágenes desafiantes.

18.- Quedan preguntas abiertas sobre cómo se desarrolla la vía ventral y apoya el aprendizaje de tareas.

19.- Los datos neuronales pueden constriñir modelos, pero el nivel apropiado de granularidad (por ejemplo, el tiempo de los picos) no está claro.

20.- Analizar las respuestas neuronales a imágenes naturales (por ejemplo, el conjunto de datos MS COCO) puede informar modelos de visión más robustos.

21.- Los modelos de aprendizaje profundo también han mostrado ser prometedores en predecir respuestas en los sistemas auditivo y somatosensorial.

22.- El cerebro probablemente logra una forma de convolución sin compartir pesos explícitamente, posiblemente a través del aprendizaje y desarrollo.

23.- La colaboración continua entre neurociencia y visión por computadora podría llevar a modelos mejorados de la función cerebral y aplicaciones de ingeniería.

24.- Las mediciones anatómicas detalladas (por ejemplo, conectómica) podrían informar aún más las arquitecturas de redes neuronales biológicamente constriñidas.

25.- Integrar el aprendizaje profundo y la neurociencia puede potencialmente avanzar en interfaces cerebro-máquina y tratamientos neurológicos.

Bóveda de Conocimiento construida porDavid Vivancos 2024